Llevo meses usando Claude Code casi a diario y, con el tiempo, he ido filtrando qué skills realmente cambian cómo trabajo y cuáles son ruido. Esta lista de las mejores extensiones para Claude Code es mi opinión personal. Sin patrocinio, sin afiliados, solo lo que uso de verdad.

Las he probado todas en proyectos reales: comprimir prompts, humanizar texto generado por IA, memorias entre sesiones, revisar código con varios agentes… cada complemento aporta algo concreto. He descartado decenas; estas cinco se han quedado.

Hablamos de Caveman, Humanizer, Nadkin, Claude-mem y Ultra-review. Empezamos.

- Caveman — cuando cada token cuenta

- Cómo se usa

- Humanizer — porque el texto de IA se nota demasiado

- Ejemplo rápido

- Nadkin — la IA que aprende de sus propios errores

- El archivo que genera

- Claude-mem — memoria real entre sesiones

- Tipos de memoria que guarda

- Ultra-review — análisis de código en serio

- Cómo lanzarla

- En resumen

Caveman — cuando cada token cuenta

El nombre es raro, lo sé. Pero lo que hace tiene mucho sentido (JuliusBrussee/caveman): comprime tus prompts para que Claude consuma la menor cantidad posible de tokens sin perder información relevante. En la práctica, es como si escribieras en telegrama pero Claude lo entendiera perfectamente.

Lo notas especialmente en proyectos grandes o conversaciones largas donde el contexto empieza a saturarse. Con Caveman, puedo meter más cosas dentro del mismo límite. No es magia, pero ayuda bastante.

Cómo se usa

/caveman

Eres un asistente que ayuda a optimizar código Python para producción. El proyecto usa FastAPI, PostgreSQL y Redis. Tengo un bug en el endpoint de autenticación donde los tokens JWT no se invalidan correctamente al hacer logout...Claude lo comprime solo antes de procesarlo. Tú escribes normal, él trabaja con menos.

Humanizer — porque el texto de IA se nota demasiado

Si usas Claude para escribir contenido, ya sabes el problema. Ese tono de PowerPoint corporativo, las frases que empiezan con «Es importante destacar que…», los listados de tres puntos perfectamente simétricos. Todo el mundo lo reconoce ahora mismo.

Humanizer localiza esos patrones y los elimina. No es solo quitar palabras de relleno; reescribe para que suene a alguien real. He probado otros métodos y ninguno funciona tan bien como este porque trabaja con una lista muy concreta de patrones documentados (está basado en la guía de Wikipedia sobre escritura IA).

Este es el link al repositorio (blader/humanizer). Juzga tú mismo.

Ejemplo rápido

| Antes (IA pura) | Después (Humanizer) |

|---|---|

| «Es fundamental destacar que esta solución representa un avance significativo en el panorama tecnológico actual.» | «Funciona. Y eso ya es bastante.» |

| «Cabe mencionar que los resultados obtenidos subrayan la importancia de adoptar un enfoque holístico.» | «Los números mejoraron. Probablemente porque dejamos de complicarlo tanto.» |

Nadkin — la IA que aprende de sus propios errores

Esta es la que más me ha sorprendido. Cuando Claude comete un error, Nadkin lo registra en un archivo markdown. No para esa sesión. Para siempre. La próxima vez que abras Claude en ese proyecto, sabe qué no hacer.

Parece pequeño, pero en proyectos largos cambia bastante la experiencia. Deja de tener que repetir «ya te dije que no hagas esto así» cada dos semanas. El contexto acumulado de los fallos queda guardado y Claude lo consulta antes de actuar.

El archivo que genera

# Errores aprendidos — proyecto ftechpilot

## CSS

- No usar \uXXXX en la propiedad `content` de CSS. El navegador lo interpreta

como texto literal. Usar el carácter directamente: '+', '-', '>'

## WordPress API

- Los snippets run-once (11 y 12) NO se deben reactivar. Ya se ejecutaron.

- Después de cambiar CSS visual, avisar al usuario de hacer Purge All en LiteSpeed.

## Snippets

- El snippet de purga (9) debe quedar inactivo después de usarse.

Activar → disparar → desactivar. Nunca dejar activo.Eso es literalmente lo que guarda en mi proyecto.

No tiene repositorio público propio — viene incluida en colecciones de skills de la comunidad como anthropics/skills.

Cada línea es un error que no volverá a pasar.

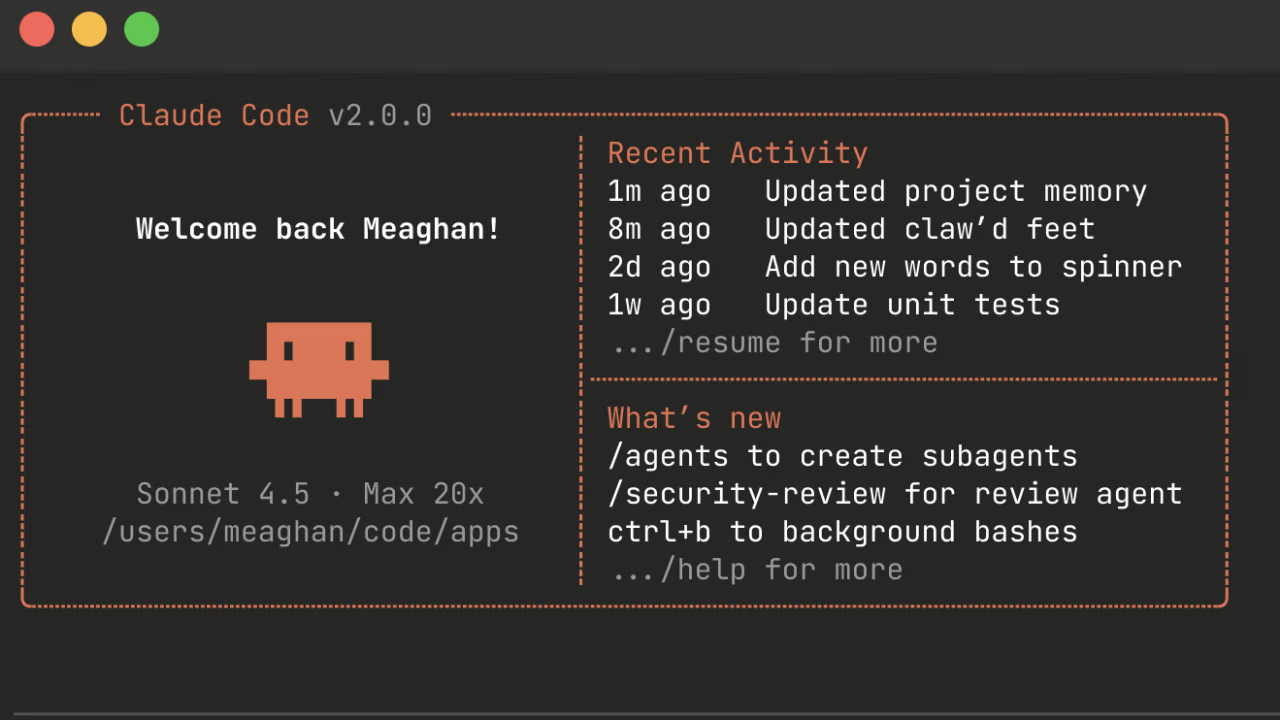

Claude-mem — memoria real entre sesiones

El problema clásico de los asistentes de IA: cada vez que abres una conversación nueva, empieza de cero (thedotmack/claude-mem). Si tienes un proyecto con tres semanas de historia, tienes que explicarlo otra vez. Eso gasta tokens y tiempo.

Claude-mem guarda contexto relevante entre sesiones en archivos de memoria estructurados. Quién eres, cómo prefieres trabajar, qué proyectos tienes activos, decisiones técnicas tomadas. La próxima vez que abras Claude, lee eso primero.

La diferencia más notable no es en la primera sesión. Es en la décima. Cuando Claude ya sabe que usas TypeScript estricto, que no quieres comentarios obvios en el código, y que este proyecto específico tiene una restricción de arquitectura particular. Ese contexto acumulado vale mucho.

Tipos de memoria que guarda

- Usuario — tu rol, expertise, preferencias de trabajo

- Proyecto — contexto activo, decisiones técnicas, fechas relevantes

- Feedback — qué hace bien, qué no debe repetir

- Referencia — dónde vive la información externa (Jira, Notion, etc.)

Ultra-review — análisis de código en serio

La más técnica de las cinco.

Integrada directamente en Claude Code — no requiere instalación manual. Documentación oficial: code.claude.com/docs/en/code-review.

Ultra-review lanza un análisis multi-agente de tu código: seguridad, consistencia, deuda técnica, patrones problemáticos. No es un linter. Es más parecido a una revisión de código que haría un equipo senior.

No la uso cada día. La uso antes de merges importantes o cuando tengo la sensación de que algo no está bien pero no sé dónde. Cada vez que la corro sale algo útil, normalmente cosas que habría tardado mucho en ver por mí mismo.

Cómo lanzarla

# Revisar la rama actual

/ultrareview

# Revisar una PR de GitHub específica

/ultrareview 47La primera forma analiza los cambios de tu rama local. La segunda toma directamente una pull request de GitHub. El análisis tarda un poco porque son varios agentes trabajando en paralelo, pero el resultado es bastante más completo que un review manual rápido.

En resumen

Si tuviera que quedarme con dos, serían Nadkin y Claude-mem. La combinación de memoria de errores y memoria de contexto es lo que más cambia la calidad del trabajo a largo plazo. Las otras tres son muy útiles, pero estas dos son las que hacen que trabajar con Claude se sienta diferente al cabo de un mes.

Si usas alguna que no esté en esta lista y crees que se merece hablar de ella, déjamelo saber en comentarios. 🙂